Rohm développe un circuit d’IA basse consommation pour l’edge computing

Le Japonais a développé un circuit d’IA basse consommation permettant de réaliser l’apprentissage et les inférences directement au niveau des équipements industriels, sans passer par le cloud, en vue de détecter leurs défaillances potentielles en temps réel.

Généralement, les puces d’IA, qui effectuent des apprentissages et des inférences pour réaliser des fonctions d’intelligence artificielle, nécessitent qu’une grande quantité de données soit capturée, compilée dans une base de données et mise à jour. Ce qui nécessite une puissance de calcul importante, impliquant une consommation d’énergie élevée de ces circuits. Rohm compte résoudre le problème avec le développement de circuits d’IA capables d’apprendre et de réaliser des inférences directement sur le terrain, au niveau des équipements industriels en périphérie de réseau (capteurs, moteurs, etc.), et cela, en consommant peu d’énergie.

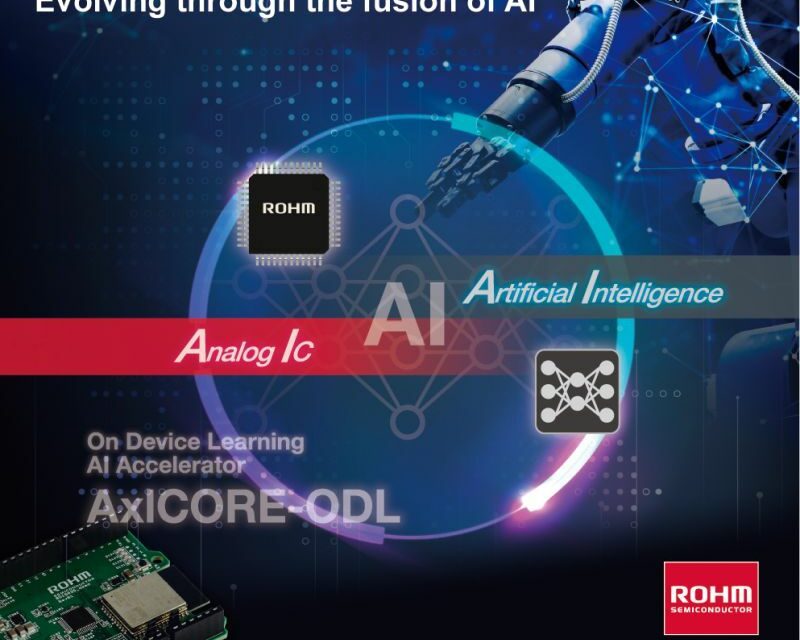

Basé sur un « algorithme d’apprentissage sur appareil » (on-device learning algorithm) développé par le professeur Matsutani de l’Université de Keio, le circuit d’IA de Rohm référencé BD15035 est logé dans un boîtier TQFP48V de 9 x 9 x 1,2 mm et se compose principalement d’un accélérateur d’IA à 20 000 portes (circuit de réseau neuronal à trois couches), l’AxICORE-ODL, et d’un processeur 8 bits à haut rendement propriétaire de Rohm, le tinyMicon MatisseCORE, l’ensemble permettant l’apprentissage et les inférences directement sur le terminal, sans impliquer un serveur cloud, avec une consommation d’énergie réduite à seulement quelques dizaines de mW, là où un circuit d’IA dans le cloud nécessitera une consommation 1000 fois supérieure, selon Rohm.

Ce circuit permet de prévoir en temps réel les défaillances d’équipements périphériques dans un large éventail d’applications, car les résultats de détection d’anomalies peuvent être générés numériquement pour des données d’entrée inconnues (accélération, courant, luminosité, voix) sur le site où l’équipement est installé, sans passer par un serveur cloud.

« À mesure que les technologies IoT telles que la communication 5G et les jumeaux numériques progressent, le cloud computing devra évoluer, mais le traitement de toutes les données sur des serveurs cloud n’est pas toujours la meilleure solution en termes de charge, de coût et de consommation d’énergie, précise le professeur Hiroki Matsutani, du département “Information and Computer Science” de l’université de Keio, au Japon. Avec les « algorithmes d’apprentissage sur appareil » que nous avons développés, nous visons à obtenir un traitement des données plus efficace du côté de la périphérie pour construire un meilleur écosystème IoT. »

Une carte d’évaluation est proposée pour tester les performances de ce circuit d’IA. Elle intègre notamment une interface pour carte Arduino, un module Wi-Fi/Bluetooth ainsi qu’une Eeprom de 64 kbit. Rohm prévoit d’intégrer l’accélérateur IA utilisé dans cette puce d’IA dans divers circuits de commande pour moteurs et capteurs. La commercialisation est envisagée en 2023, avec une production de masse prévue pour 2024.