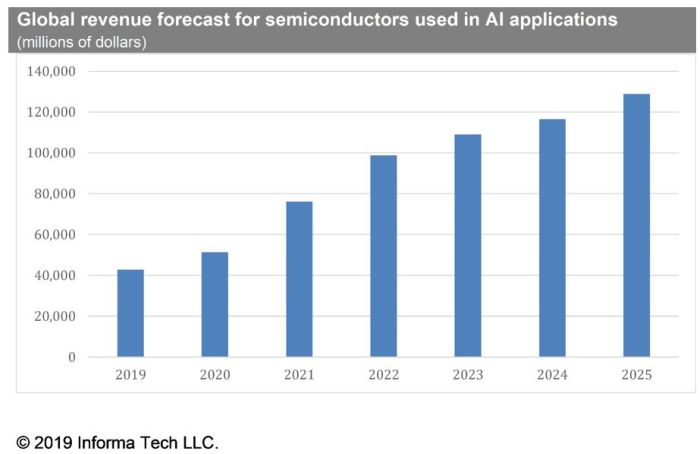

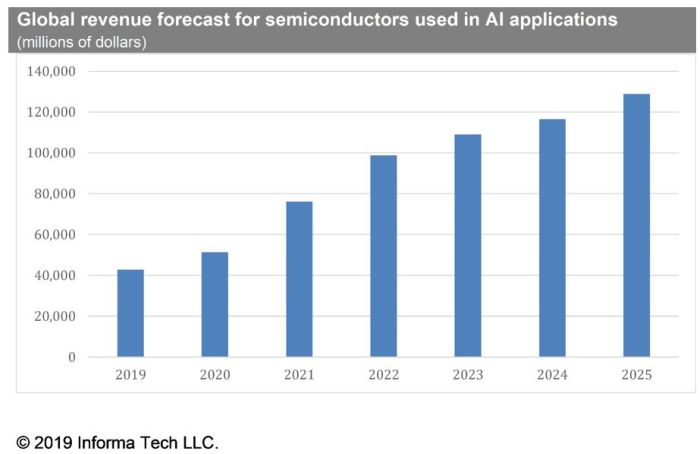

Les ventes de semiconducteurs avec fonctions d’IA devraient tripler d’ici 2025

Le marché mondial des mémoires et des semiconducteurs de traitement des données utilisés dans les applications d’intelligence artificielle (IA) atteindra 128,9 milliards de dollars en 2025, soit trois fois le total de 42,8 milliards de dollars en 2019, selon IHS Markit, désormais intégré à Informa Tech.

« Les semiconducteurs représentent le fondement de la chaîne d’approvisionnement de l’IA, fournissant les capacités de traitement et de mémoire essentielles requises pour chaque application d’intelligence artificielle », a déclaré Luca De Ambroggi, directeur de recherche senior pour l’IA chez IHS Markit.

Dans le segment de l’IA, les revenus mondiaux provenant des mémoires pour les applications d’IA passeraient à 60,4 milliards de dollars en 2025, contre 20,6 milliards de dollars en 2019. Le segment des processeurs augmenterait encore plus rapidement, atteignant 68,5 milliards de dollars en 2025, contre 22,2 milliards de dollars en 2019.

Les puces IA sont utilisées sur divers marchés, notamment l’automobile, les télécommunications, l’nofirmatique, l’électronique grand public, l’industrie et la santé. Le plus grand marché unique pour les mémoires dans les applications d’IA est le segment des ordinateurs, avec des ventes atteignant 65,9 milliards de dollars en 2025, augmentant à un taux annuel moyen de 15,7% par rapport aux 27,5 milliards de dollars en 2019. Cependant, d’autres segments généreront une croissance plus rapide : les secteurs des télécommunications, de l’électronique grand public, de l’industrie et de la santé.

Des architectures de processeurs pilotées par l’IA émergent

Plusieurs start–up visent maintenant à proposer des architectures entièrement nouvelles qui remettront en cause la suprématie du marché des appareils traditionnels utilisés pour le traitement de l’IA, tels que les unités de traitement graphique (GPU), les FPGA, les microprocesseurs, les microcontrôleurs et les processeurs de signaux numériques (DSP). Ces nouvelles architectures incluent des fonctionnalités telles que le traitement vectoriel intégré, qui peut accélérer les tâches d’apprentissage en profondeur.

« Les anciennes définitions de ce qui fait un MPU, DSP ou MCU commencent à s’estomper à l’ère de l’IA, car chaque type de périphérique ajoute des cœurs avec différentes fonctions de base », a déclaré De Ambroggi. « De plus en plus, les concepteurs de systèmes compatibles avec l’IA utilisent des solutions de traitement hétérogène hautement intégrées, telles que des circuits intégrés spécifiques (Asic) et des systèmes sur puce (SoC). Avec les fabricants de processeurs proposant des solutions de traitement hétérogènes clé en main utilisant ces ASIC et SoC, il est moins important pour les concepteurs de systèmes que leur algorithme d’intelligence artificielle soit exécuté sur un GPU, un CPU ou un DSP ».